No dia 27 de maio eu acordei e fui dar uma olhada rápida no X (antigo Twitter) para ver as principais notícias do dia. Na bolha que acompanho, só se falava de uma coisa: “A Documentação Interna de Engenharia Content Warehouse de Pesquisa do Google Vazou”.

Eu fiquei assustado com o tanto que a comunidade estava falando sobre o assunto. Sabe o que é pior?! Não vi nenhum portal brasileiro falando sobre, na verdade ontem (28), o Diego Ivo CEO da Conversion, uma das principais agencias de SEO do Brasil, fez um vídeo e um resumo falando do tema.

Bom, como minha colaboração pra comunidade, eu resolvi trazer a informação aqui resumida, com base no artigo do Mike King, que foi o primeiro a escrever sobre o assunto, e sinceramente, a análise mais completa falando da versão interna da documentação do absoleto Document AI Warehouse que foi acidentalmente publicada publicamente em um repositório de código da biblioteca do cliente.

Embora não haja detalhes sobre as funções de pontuação do Google na documentação, há uma riqueza de informações sobre dados armazenados sobre conteúdo, links e interações do usuário.

É importante destacar aqui que seria impreciso chamar esses dados de “fatores de classificação”, mas muitos dos módulos que estão presente no vazamento do Google, mesmo que a maioria sejam fatores de classificação, muitos não são.

O que é Document AI Warehouse?

O Document AI Warehouse é uma solução da Google Cloud que facilita a gestão, análise e processamento de documentos empresariais. Utilizando tecnologias avançadas de inteligência artificial, esta ferramenta permite extrair informações relevantes, organizar e compreender grandes volumes de documentos digitais.

Document AI Warehouse é projetado para melhorar a eficiência dos processos de negócios ao automatizar tarefas repetitivas, como extração de dados, categorização e pesquisa de conteúdo, proporcionando insights valiosos a partir dos documentos processados.

O que foi vazado?

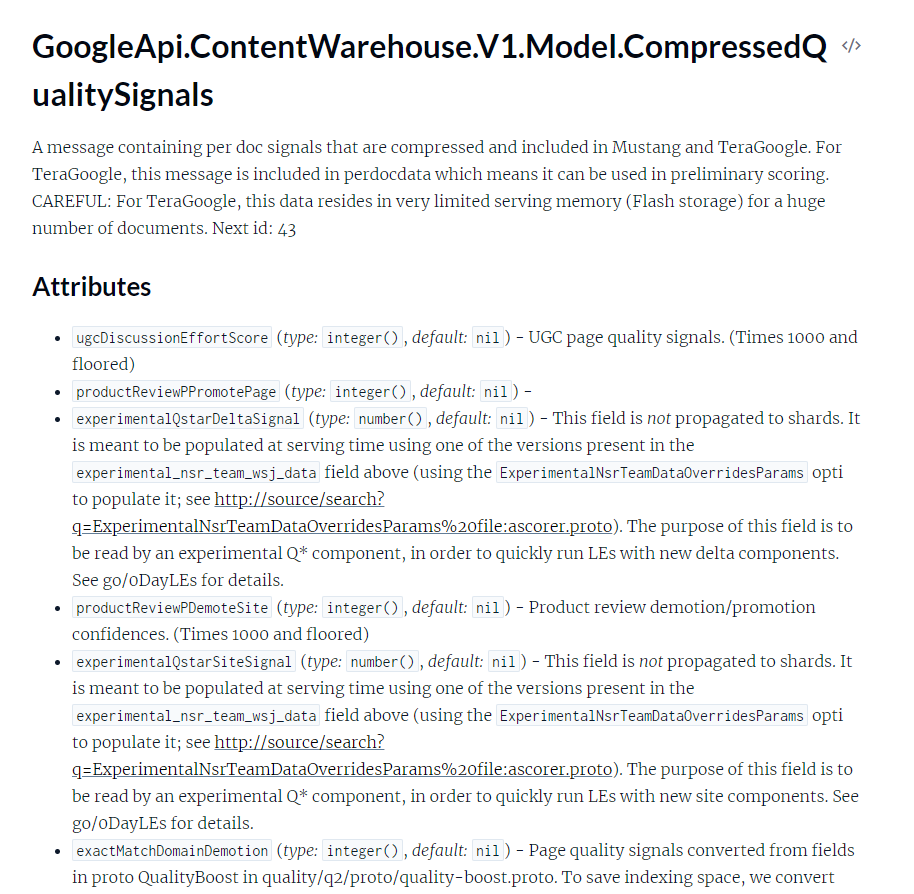

Na documentação da API com 14.014 atributos (recursos), existem 2.596 módulos. Os módulos estão relacionados a componentes do YouTube, Assistente, Livros, pesquisa de vídeos, links, documentos da web, infraestrutura de rastreamento, sistema de calendário interno e API People.

Além disso, a documentação vazada descreve cada módulo da API e os divide em resumos, tipos, funções e atributos. A maior parte vista são as definições de propriedades para vários buffers de protocolo (ou protobufs) que são acessados nos sistemas de classificação para gerar SERPs (Search Engine Results Page – Páginas de Resultados de Mecanismos de Pesquisa).

Qual o impacto desse vazamento?

Há anos o Google fez de tudo para direcionar, há quem diga enganar, em vários aspectos relacionados a como o sistema de busca funciona.

Como o próprio Mike diz: “As declarações públicas do Google provavelmente não são esforços intencionais para mentir, mas sim para enganar potenciais spammers (e também muitos SEOs legítimos) para nos despistar de como impactar os resultados de pesquisa.”

Abaixo vou listar os principais pontos, que contradizem muitas destas declarações e que mudarão completamente a sua forma de fazer SEO daqui pra frente.

Autoridade de Domínio

Os porta-vozes do Google disseram inúmeras vezes que não usam “autoridade de domínio”, quando na realidade, como parte dos sinais de qualidade compactados que são armazenados por documento vazado, o Google tem um recurso que calcula, sendo chamado de “siteAuthority” na documentação.

Não dá pra saber exatamente como esta medida é calculada ou utilizada nas funções de pontuação, mas agora sabemos que ela existe e é utilizada no sistema de classificação.

Classificação Baseada em Cliques

Outra frase muito dita em declarações do Google é a famosa: “Não usamos cliques para classificações”.

Segundo a documentação vazada, o Google usa várias métricas de cliques para ajudar a classificar os resultados da pesquisa, incluindo:

- Cliques ruins: Cliques em resultados que o usuário rapidamente abandona (indicando que o resultado não era relevante).

- Cliques bons: Cliques em resultados que o usuário permanece por um tempo considerável (indicando que o resultado era relevante).

- Últimos cliques mais longos: Cliques em resultados que são os últimos na sessão de pesquisa e em que o usuário passa mais tempo.

- Cliques não esmagados e últimos cliques mais longos não esmagados: Cliques que são considerados sem a influência exagerada de um único sinal.

Para facilitar a compreensão, imagine que três pessoas pesquisem “restaurantes italianos perto de mim” e cliquem nos seguintes links:

- Pessoa A: Clica no primeiro link, mas volta imediatamente para a página de resultados (clique ruim).

- Pessoa B: Clica no segundo link e passa 10 minutos navegando no site do restaurante (clique bom).

- Pessoa C: Clica no terceiro link, passa 5 minutos, volta aos resultados e depois clica no segundo link e fica lá por 15 minutos (último clique mais longo).

Cliques longos são uma medida do sucesso de uma sessão de pesquisa, assim como o tempo de permanência, mas não há nenhum recurso específico chamado “tempo de permanência” nesta documentação. No entanto, cliques longos são efetivamente medidas da mesma coisa, contradizendo as declarações do Google sobre o assunto.

SendBox

A SendBox foi inúmeras vezes testada e confirmada pela comunidade, mas mesmo assim, o Google insistia em negar a sua existência . Em um dos módulos da documentação da API, chamado PerDocData, indica um atributo chamado hostAge que é usado especificamente “para proteger spam novo no tempo de veiculação”.

Nenhuma novidade, certo?!

Autores e EEAT

É muito comum e ouve-se muito falar sobre EEAT (Expertise, Authoritativeness, and Trustworthiness) na comunidade SEO, mas o que não se sabia, era que o Google armazena explicitamente os autores associados as páginas e tenta identificar se uma entidade na página é também o autor. Combinado com o mapeamento de entidades e incorporações, fica claro que o Google mede de forma abrangente quem é o autor do anúncio associando-o ao EEAT do conteúdo.

A camada de indexação afeta o valor do link

O Google utiliza uma métrica chamada “sourceType” para relacionar onde uma página é indexada com seu valor. O índice do Google é dividido em camadas: o conteúdo mais importante e frequentemente atualizado é armazenado na memória flash, o menos importante em unidades de estado sólido, e o conteúdo atualizado irregularmente em discos rígidos padrão.

Quanto mais alta a camada, mais valioso é o link. Páginas mais recentes são vistas como de alta qualidade, e links dessas páginas, especialmente de páginas de alta classificação e notícias, melhoram o desempenho de classificação. Isso realça a importância de obter links de fontes novas e de alta camada, revitalizando a importância das relações públicas digitais.

Sinais de velocidade de spam de links

Além disso, o Google possui uma série de métricas para identificar picos de spam em textos âncora, como a métrica “phraseAnchorSpamDays”. Essa métrica permite ao Google medir a velocidade com que links de spam são criados.

Isso pode ser usado para detectar quando um site está praticando spam e para neutralizar ataques negativos de SEO. Para os céticos, o texto esclarece que o Google pode usar esses dados para comparar a linha de base de descoberta de links com a tendência atual e simplesmente desconsiderar esses links, evitando que afetem negativamente o site alvo.

O PageRank da página inicial é considerado para todas as páginas

Cada documento tem seu PageRank de página inicial (a versão mais próxima do seed) associado a ele. Provavelmente é usado como proxy para novas páginas até que elas capturem seu próprio PageRank. É provável que este e “siteAuthority” sejam usados como proxies para novas páginas até que tenham seu próprio PageRank calculado.

O Google decide como avaliar um link com base no quanto eles confiam na página inicial. Como sempre, você deve se concentrar na qualidade e relevância de seus links, em vez de no volume.

O tamanho da fonte dos termos e links é importante

É comum, principalmente em ferramentas de SEO, cer recomendações de que palavras-chaves devem estar em negrito ou sublinhado para tornar os termos mais importantes. Segundo a documentação vazada, o Google está rastreando o tamanho médio da fonte dos termos, e também nos textos âncoras dos links.

Por isso, acho válido manter essa prática para garantir a identificação de um termo de descoberta e/ou palavra-chave.

O conteúdo curto é avaliado pela originalidade

O módulo “OriginalContentScore” contido na documentação sugere que o conteúdo curto seja pontuado por sua originalidade. É provavelmente por isso que o conteúdo superficial nem sempre é uma função do comprimento.

Os títulos das páginas ainda são medidos em relação às consultas

A documentação indica que existe um “titlematchScore”. A descrição sugere que a correspondência do título da página com a consulta ainda é algo que o Google valoriza ativamente.

Ou seja, colocar as palavras-chave em primeiro lugar ainda é a decisivo para a classificação de uma página.

Não há medidas de contagem de caracteres

Não há nenhuma métrica neste conjunto de dados vazados que conte o comprimento dos títulos ou snippets das páginas. A única medida de contagem de caracteres encontrada na documentação é o “snippetPrefixCharCount” que parece estar definido para determinar o que pode ser usado como parte do snippet.

Isso reforça a hipótese que: títulos de páginas longos não são ideais para gerar cliques, mas são bons para gerar classificações.

Conteúdos gerados por IAs

Não há indicação do que isso significa, mas a descrição menciona “documentos rotulados por humanos” versus “anotações rotuladas automaticamente”. O que sugere um processo de anotação de dados que pode envolver inteligência artificial.

Embora o Google afirme que as classificações de qualidade não afetam diretamente as classificações de busca, o uso de IA para rotular dados pode fazer parte de um sistema maior de avaliação da qualidade dos resultados de pesquisa.

O Google pode estar rebaixando pequenos sites de propósito

O Google tem um sinalizador específico que indica que o site é um “pequeno site pessoal”. Não existe uma definição clara para estes sites, mas com base em tudo o que sabemos, não seria difícil para eles adicionar um Twiddler que impulsionasse esses sites ou que os rebaixasse.

Conclusão

Por mais que o jogo esteja mudando drasticamente com a incorporação de IAs no mecanismo de busca e o próprio ChatGPT (eu li relatos de queda de mais de 30% no tráfego orgânico de sites administrados por profissionais de SEO experientes – isso ainda não está impactando muito aqui no Brasil), mas esse vazamento ajuda a deixar as coisas mais claras.

Por muito tempo, essas teorias circulavam pela comunidade SEO como mitos ou verdades. Agora temos a certeza que esses pontos são sim importantes e devem ser levados em consideração nas estratégias de sites e blogs que querem chegar ao topo da primeira página do Google.

Por isso, entenda o seu público, identifique o que ele deseja, faça o melhor possível que se alinhe com isso. Para todos em SEO que não têm certeza do que estão fazendo, continuem testando, aprendendo e expandindo os negócios.

Fonte e créditos para: Secrets from the Algorithm: Google Search’s Internal Engineering Documentation Has Leaked